python 深度學(xué)習(xí)中的4種激活函數(shù)

這篇文章用來(lái)整理一下入門深度學(xué)習(xí)過(guò)程中接觸到的四種激活函數(shù),下面會(huì)從公式、代碼以及圖像三個(gè)方面介紹這幾種激活函數(shù),首先來(lái)明確一下是哪四種:

Sigmoid函數(shù) Tahn函數(shù) ReLu函數(shù) SoftMax函數(shù)激活函數(shù)的作用

下面圖像A是一個(gè)線性可分問(wèn)題,也就是說(shuō)對(duì)于兩類點(diǎn)(藍(lán)點(diǎn)和綠點(diǎn)),你通過(guò)一條直線就可以實(shí)現(xiàn)完全分類。

當(dāng)然圖像A是最理想、也是最簡(jiǎn)單的一種二分類問(wèn)題,但是現(xiàn)實(shí)中往往存在一些非常復(fù)雜的線性不可分問(wèn)題,比如圖像B,你是找不到任何一條直線可以將圖像B中藍(lán)點(diǎn)和綠點(diǎn)完全分開的,你必須圈出一個(gè)封閉曲線。

而激活函數(shù)就是幫助'繪制'這個(gè)封閉曲線的非線性函數(shù),有了激活函數(shù)的幫助,很多算法的處理能力會(huì)得到加強(qiáng),也可以處理線性不可分問(wèn)題。

Sigmoid函數(shù)

Sigmoid函數(shù)曾在介紹邏輯回歸時(shí)提起過(guò),它的數(shù)學(xué)表達(dá)式為:

其中 e 為納皮爾常數(shù),其值為2.7182... 它的圖像如下:

可以觀察出圖像的一些特點(diǎn):

曲線的值域?yàn)?0,1) 當(dāng)x = 0時(shí),Sigmoid函數(shù)值為0.5 隨著 x 不斷增大,Sigmoid函數(shù)值無(wú)限趨近于1 隨著 x 不斷減小,Sigmoid函數(shù)值無(wú)限趨近于0對(duì)于梯度下降法而言,信息的更新很大程度上都取決于梯度,而Sigmoid函數(shù)一個(gè)很明顯的缺點(diǎn)就是當(dāng)函數(shù)值特別靠近0或1這兩端時(shí),因?yàn)樗那€已經(jīng)近乎平緩,所以此時(shí)的梯度幾乎為0,這樣非常不利于權(quán)重的更新,從而就會(huì)導(dǎo)致模型不收斂。

Sigmoid函數(shù)的代碼如下:

import numpy as npdef tanh(x): return (exp(x)-exp(-x))/(exp(x)+exp(-x))

Tanh函數(shù)

Tanh函數(shù)是雙曲正切函數(shù),它的的數(shù)學(xué)表達(dá)式為:

Tanh函數(shù)和Sigmoid函數(shù)非常相近,這點(diǎn)從圖像上可以很好的體現(xiàn):

這兩個(gè)函數(shù)相同的是,當(dāng)輸入的 x 值很大或者很小時(shí),對(duì)應(yīng)函數(shù)輸出的 y 值近乎相等,同樣的缺點(diǎn)也是梯度特別小,非常不利于權(quán)重的更新;不同的是Tanh函數(shù)的值域?yàn)?-1,1),并且當(dāng) x = 0 時(shí),輸出的函數(shù)值為0。

Tanh函數(shù)的代碼如下:

import numpy as npdef tanh(x): return (exp(x)-exp(-x))/(exp(x)+exp(-x))

ReLu函數(shù)

ReLu是線性整流函數(shù),又稱為修正性線性單元,它的函數(shù)的數(shù)學(xué)表達(dá)式為

Tanh是一個(gè)分段函數(shù),它的圖像如下:

圖像很容易理解,若輸入的 x 值小于0,則輸出為也為0;若輸入的 x 值大于0,則直接輸出 x 值,需要注意的是ReLu函數(shù)在x = 0 處不連續(xù)(不可導(dǎo)),但同樣也可以作為激活函數(shù)。

與Sigmoid函數(shù)和Tanh函數(shù)相比,ReLu函數(shù)一個(gè)很明顯的優(yōu)點(diǎn)就是在應(yīng)用梯度下降法是收斂較快,當(dāng)輸入值為整數(shù)時(shí),不會(huì)出現(xiàn)梯度飽和的問(wèn)題,因?yàn)榇笥?的部分是一個(gè)線性關(guān)系,這個(gè)優(yōu)點(diǎn)讓ReLu成為目前應(yīng)用較廣的激活函數(shù)。

ReLu函數(shù)的代碼如下:

import numpy as npdef relu(x): return np.maximum(0,x)

SoftMax函數(shù)

分類問(wèn)題可以分為二分類問(wèn)題和多分類問(wèn)題,Sigmoid函數(shù)比較適合二分類問(wèn)題,而SoftMax函數(shù)更加適合多分類問(wèn)題。SoftMax函數(shù)的數(shù)學(xué)表達(dá)式為:

其中Vi表示分類器的輸出,i表示類別索引,總的類別個(gè)數(shù)為C,Si表示當(dāng)前元素的指數(shù)與所有元素指數(shù)和的比值。概括來(lái)說(shuō),SoftMax函數(shù)將多分類的輸出值按比例轉(zhuǎn)化為相對(duì)概率,使輸出更容易理解和比較。

為了防止SoftMax函數(shù)計(jì)算時(shí)出現(xiàn)上溢出或者下溢出的問(wèn)題,通常會(huì)提前對(duì) V 做一些數(shù)值處理,即每個(gè) V 減去 V 中的最大值,假設(shè)D=max(V),SoftMax函數(shù)數(shù)學(xué)表達(dá)式更改為:

因?yàn)镾oftMax函數(shù)計(jì)算的是概率,所以無(wú)法用圖像進(jìn)行展示,SoftMax函數(shù)的代碼如下:

import numpy as npdef softmax(x): D = np.max(x) exp_x = np.exp(x-D) return exp_x / np.sum(exp_x)

以上就是python 深度學(xué)習(xí)中的4種激活函數(shù)的詳細(xì)內(nèi)容,更多關(guān)于python 激活函數(shù)的資料請(qǐng)關(guān)注好吧啦網(wǎng)其它相關(guān)文章!

相關(guān)文章:

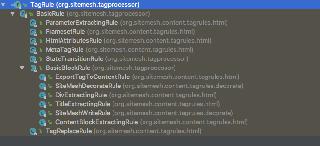

1. 使用 kind 和 Docker 啟動(dòng)本地的 Kubernetes環(huán)境2. jsp中sitemesh修改tagRule技術(shù)分享3. Docker究竟是什么 為什么這么流行 它的優(yōu)點(diǎn)和缺陷有哪些?4. docker容器調(diào)用yum報(bào)錯(cuò)的解決辦法5. IntelliJ IDEA導(dǎo)出項(xiàng)目的方法6. Django中如何使用Channels功能7. idea設(shè)置代碼格式化的方法步驟8. intellij idea寫Python教程9. python的json包位置及用法總結(jié)10. 關(guān)于html嵌入xml數(shù)據(jù)島如何穿過(guò)樹形結(jié)構(gòu)關(guān)系的問(wèn)題

網(wǎng)公網(wǎng)安備

網(wǎng)公網(wǎng)安備