文章詳情頁

python - celery工作流的問題

瀏覽:218日期:2022-09-12 10:43:10

問題描述

celery中,我做這樣的處理:一個url經過a, b, c三個的函數,分別獲得返回值,其中任意函數結果均與任意其他函數結果不相關,然后匯總起來,交給之后的流程.這樣,我自然想到并行運行三個函數來加快處理速度.然而由于一開始的設計問題, a函數式被設計成了一次可以處理多個url的形式,而一個一個的處理會非常慢.

@celery.taskdef a(url_list): ’...do something...’ for url in url_list:b.delay(url)

我嘗試這樣控制,然而任務似乎并不能嵌套.那么,如何設計可以比較好的滿足我這種比較奇怪的流程和要求呢?

問題解答

回答1:應該把a;b;c拆開,寫成3個task, 同時數據庫里要保存一個狀態值,用來表示3個任務的執行狀態,一個任務執行完成后,就修改狀態值,并檢查其他2個任務是否完成,如果都完成了,就匯總任務結果,再處理。

回答2:@xiaoboost 手工維護狀態可行,但有點費事。

Celery 是可以設計執行流程的,參考文檔:Designing Work-flows題主的需求可以用 chords 搞定,在 celery task 里返回值就行。

BTW: 注意一下 Celery 配置中與返回值相關的幾個選項,比如這個 task_ignore_result

相關文章:

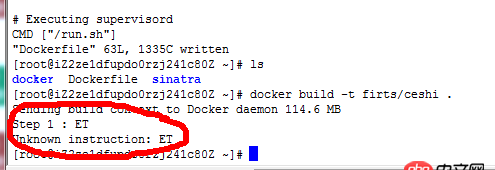

1. debian - docker依賴的aufs-tools源碼哪里可以找到啊?2. dockerfile - 我用docker build的時候出現下邊問題 麻煩幫我看一下3. docker網絡端口映射,沒有方便點的操作方法么?4. docker-compose 為何找不到配置文件?5. macos - mac下docker如何設置代理6. docker start -a dockername 老是卡住,什么情況?7. docker 下面創建的IMAGE 他們的 ID 一樣?這個是怎么回事????8. 如何解決Centos下Docker服務啟動無響應,且輸入docker命令無響應?9. angular.js使用$resource服務把數據存入mongodb的問題。10. docker gitlab 如何git clone?

排行榜

網公網安備

網公網安備