文章詳情頁

python - scrapy 爬取pages比實際進(jìn)入items的多得多?

瀏覽:163日期:2022-07-23 10:55:26

問題描述

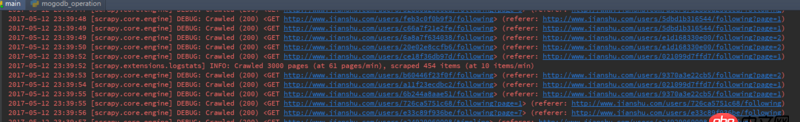

2017-05-12 23:39:52 [scrapy.extensions.logstats] INFO:Crawled 3000 pages (at 61 pages/min), scraped 454 items (at 10 items/min)

為什么我使用scrapy爬取的時候訪問pages要比實際進(jìn)入items的的多的多?就是爬了半天items里沒有幾條數(shù)據(jù)入庫的有什么辦法解決么?

問題解答

回答1:重定向了,你看到了吧,重定向就得請求兩個頁面啊。還有就是看有不有頁面解析發(fā)生了錯誤。

上一條:算法 - python ahocorasick 從本地文件讀取文本,進(jìn)行關(guān)鍵字匹配,匹配失敗下一條:運行python程序時出現(xiàn)“應(yīng)用程序發(fā)生異常”的內(nèi)存錯誤?

相關(guān)文章:

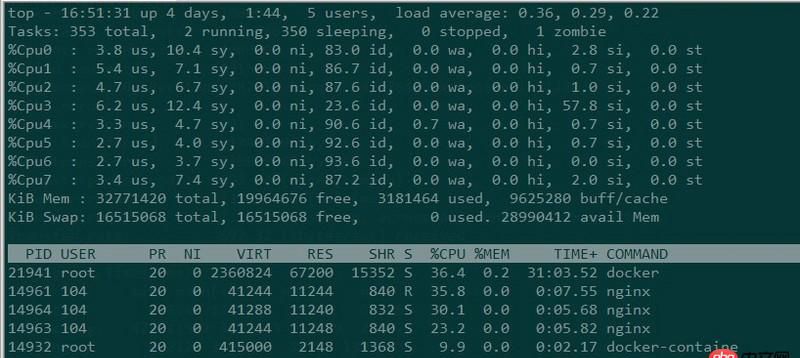

1. 關(guān)于docker下的nginx壓力測試2. Docker for Mac 創(chuàng)建的dnsmasq容器連不上/不工作的問題3. mac里的docker如何命令行開啟呢?4. 關(guān)docker hub上有些鏡像的tag被標(biāo)記““This image has vulnerabilities””5. docker容器呢SSH為什么連不通呢?6. nignx - docker內(nèi)nginx 80端口被占用7. docker - 各位電腦上有多少個容器啊?容器一多,自己都搞混了,咋辦呢?8. docker-compose 為何找不到配置文件?9. docker 下面創(chuàng)建的IMAGE 他們的 ID 一樣?這個是怎么回事????10. angular.js使用$resource服務(wù)把數(shù)據(jù)存入mongodb的問題。

排行榜

熱門標(biāo)簽

網(wǎng)公網(wǎng)安備

網(wǎng)公網(wǎng)安備